El avance de la Inteligencia Artificial (IA) ha situado a la humanidad ante un dilema fundamental. Esta tecnología posee la capacidad sin precedentes de personalizar servicios, automatizar tareas y generar riqueza, pero conlleva el riesgo inherente de amplificar las desigualdades estructurales si su desarrollo no se rige por principios éticos y de diseño universal. El concepto de IA Inclusiva emerge, por tanto, no como una opción, sino como un mandato de justicia social.

Este cuestionamiento es particularmente relevante en economías emergentes como Colombia y el resto de América Latina, donde las brechas socioeconómicas y la exclusión de poblaciones históricamente marginadas, como las personas con discapacidad (PCD), son profundas. La falta de una visión ética y proactiva en el diseño algorítmico puede transformar la IA en un amplificador de la marginación, institucionalizando el sesgo histórico en la nueva infraestructura digital. Asegurar que los beneficios de la IA sean accesibles a todos requiere un esfuerzo regulatorio y una adopción consciente del Diseño Universal desde la fase inicial de conceptualización.

Índice de temas

¿A qué se refiere el marco de ética de la IA Inclusiva?

La Inteligencia Artificial Inclusiva se define como el conjunto de prácticas de desarrollo, implementación y gobernanza de sistemas algorítmicos diseñados intencionalmente para considerar, adaptarse y beneficiar a la totalidad de la diversidad humana. Esta diversidad abarca no solo el género, la etnia y la variedad cultural, sino, de manera primordial, la diversidad funcional o discapacidad. La clave es el enfoque preventivo, donde la inclusión se integra en el diseño de los datos y el modelo, evitando que se generen barreras digitales invisibles.

El documento rector global para esta materia es la recomendación sobre la Ética de la IA de la Organización de las Naciones Unidas para la Educación, la Ciencia y la Cultura (Unesco). Este marco subraya que la IA debe ser un motor de equidad global.

La recomendación, adoptada por la comunidad internacional, interpreta la IA en un sentido amplio y dinámico para asegurar que las políticas desarrolladas se mantengan viables a pesar del rápido ritmo del cambio tecnológico. Enfatizando la justicia social como principio cardinal, establece claramente:

Los actores de la IA deberían promover la justicia social, salvaguardar la equidad y luchar contra todo tipo de discriminación, adoptando un enfoque inclusivo para garantizar que los beneficios de la IA sean accesibles para todos.

Además de la discapacidad, la Unesco ha puesto el foco en la necesidad de inclusión interseccional, destacando la urgencia de equilibrar la participación de las mujeres en el desarrollo de la IA. La Directora General de la Unesco, Audrey Azoulay, señaló que es imprescindible evitar “análisis sesgados” y garantizar que la tecnología considere las “expectativas y necesidades de toda la humanidad”.

Desde el ámbito académico, el debate ético se ha intensificado, integrando la dimensión política y la soberanía. En el contexto de la educación superior en México en 2025, autoridades académicas han propuesto:“enfoques normativos, pedagógicos y éticos para una IA inclusiva, con énfasis en la justicia social, la soberanía tecnológica y la participación de saberes diversos“.

Este llamado va más allá de la mera regulación técnica. Al vincular la inclusión con la soberanía tecnológica, se reconoce que la dependencia de sistemas de IA globales, a menudo entrenados con datos que no reflejan la realidad contextualizada de América Latina, es inherentemente excluyente y anti-soberana. La inclusión tecnológica regional no es solo un problema de acceso, sino de control sobre el desarrollo del conocimiento. La demanda de “participación de saberes diversos” es una exigencia para que la ética sea una “práctica viva y contextualizada” y obligue a las instituciones a incorporar criterios de equidad y diversidad en la ingeniería algorítmica.

¿Cuáles son los riesgos si no aplicamos una IA inclusiva?

El desarrollo de una IA inclusiva en Colombia se fundamenta en la necesidad urgente de abordar la exclusión sistemática de la población con discapacidad (PCD), una realidad cuantificada por el Departamento Administrativo Nacional de Estadística (DANE) y el Ministerio de Salud. Según los datos administrativos del Ministerio de Salud y Protección Social, basados en el Registro de Localización y Caracterización de Personas con Discapacidad (RLCPCD), un total de 350.732 personas fueron certificadas con discapacidad entre el segundo semestre de 2020 y el primer trimestre de 2024.

La precariedad económica de esta población es un factor determinante en su vulnerabilidad frente a la digitalización. Los datos revelan que la fuente de ingresos con mayor prevalencia (48.4 %) es la ayuda familiar, seguida por el rubro “No definido” (20.4 %). Apenas el 10.8 % de los ingresos provienen directamente del trabajo. Esta alta dependencia económica subraya la necesidad crítica de que la IA amplíe, y no restrinja, las oportunidades laborales.

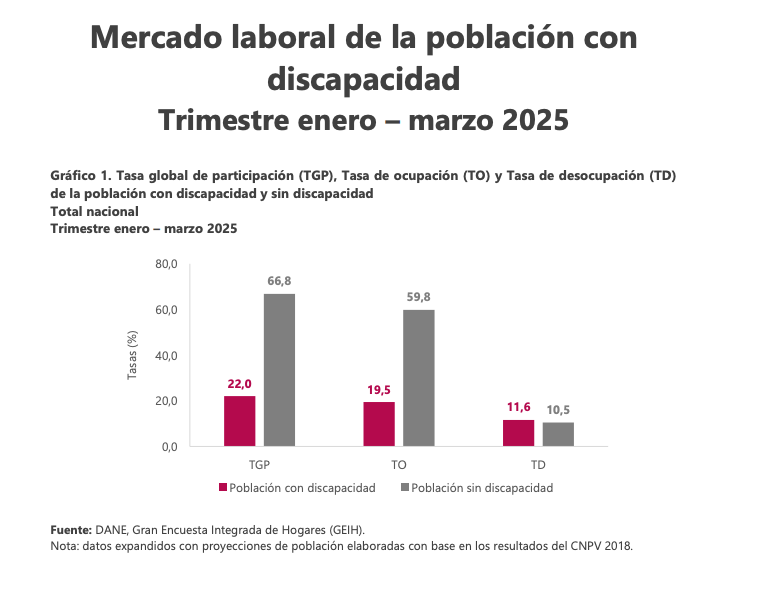

La Gran Encuesta Integrada de Hogares (GEIH) de Colombia para el período enero-marzo de 2025 confirma la magnitud de la exclusión laboral que enfrentan las PCD. Estos datos son cruciales porque establecen la base histórica que los algoritmos de reclutamiento de IA están propensos a replicar.

Existe una brecha significativa en la participación económica y la ocupación. La diferencia en la Tasa de Ocupación (TO) entre la población sin discapacidad y la población con discapacidad es de aproximadamente 38.5 puntos porcentuales, con la TO para la población sin discapacidad rondando el 60 %, mientras que para las PCD oscila entre el 19.5 % y el 21.1 %. Además, casi la mitad de las personas ocupadas con discapacidad, el 49.7 %, son trabajadores informales.

La disparidad en la Tasa Global de Participación (TGP) es igualmente marcada, con una diferencia de aproximadamente 42.0 puntos porcentuales. Estos datos reflejan que la población con discapacidad no solo tiene menos acceso al empleo, sino que cuando lo obtiene, es predominantemente en el sector informal, lo que se traduce en mayor inestabilidad y falta de seguridad social.

| Indicador Laboral (Total Nacional) | Población con Discapacidad (PCD) (I Trim. 2025) | Población sin Discapacidad (I Trim. 2025) | Diferencia (Puntos Porcentuales) |

| Tasa Global de Participación (TGP) (%) | 22.0% – 24.3% 6 | 66.3% – 66.8% 6 | Aprox. -42.0 p.p. |

| Tasa de Ocupación (TO) (%) | 19.5% – 21.1% 6 | 59.6% – 59.8% 6 | Aprox. -38.5 p.p. |

| Trabajador Informal (de la población ocupada) (%) | 49.7% 5 | N/A | Alta Precarización |

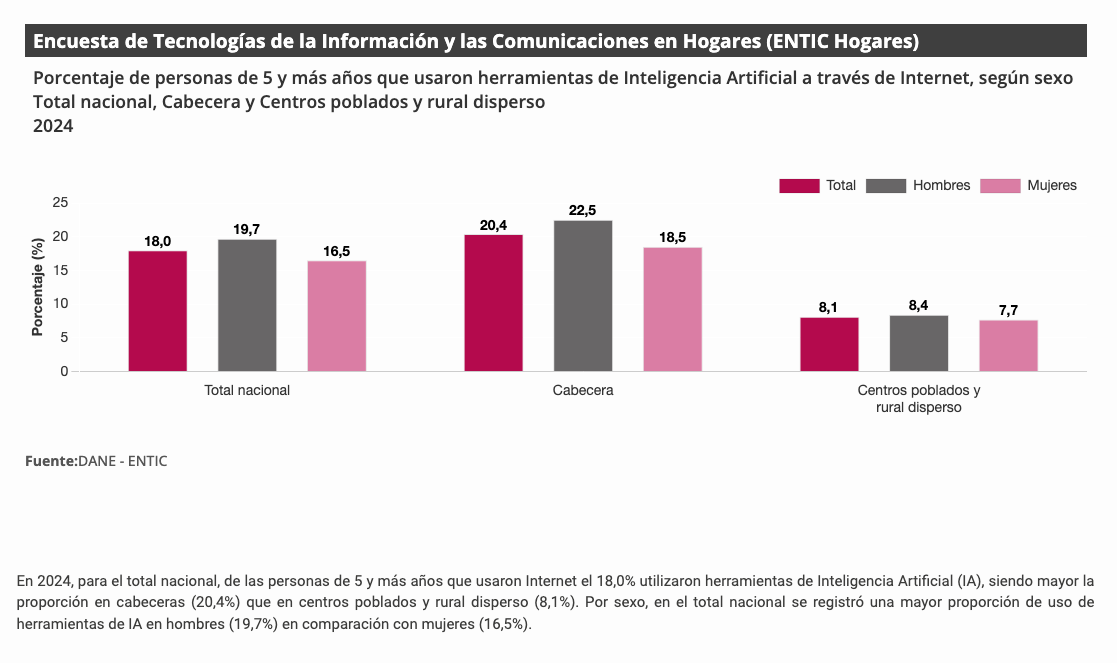

En 2024, el Dane reportó que el 18.0 % de las personas mayores de cinco años en Colombia que usan Internet ya han utilizado herramientas de Inteligencia Artificial. No obstante, ya se observa una brecha de género, con una mayor proporción de uso en hombres (19.7 %) frente a mujeres (16.5 %).

La convergencia de estos factores —una exclusión laboral formal de casi el 40 %, una alta dependencia familiar y la incipiente brecha digital en el uso de IA— establece un multiplicador de vulnerabilidad. Si los sistemas de IA, como los de reclutamiento, son entrenados con datos históricos que reflejan esta exclusión, el algoritmo interpretará automáticamente la discapacidad o las trayectorias atípicas como factores de riesgo o baja idoneidad, perpetuando y agudizando la vulnerabilidad económica de los hogares colombianos.

¿Cuáles son las barreras algorítmicas a las que se enfrentan las personas con discapacidad?: Exclusión por diseño

La exclusión digital por parte de la IA ocurre cuando los sistemas son optimizados para un usuario promedio que no representa la complejidad ni la variabilidad de la diversidad humana. La tecnología falla no por malicia, sino por falta de reconocimiento y entrenamiento diferencial, lo que genera barreras algorítmicas.

El temor a esta discriminación algorítmica es palpable, de acuerdo con el informe Tecnología y Discapacidad, del Observatorio de la Vulnerabilidad de la Fundación Adecco, el 65 % de las personas con discapacidad teme ser excluido de los procesos de selección laboral mediados por sistemas de IA.

Esta preocupación se justifica porque los algoritmos de contratación son sistemas de alto riesgo que aprenden de la historia. Dado que el historial laboral de Colombia, reflejado en los datos del Dane, ha excluido masivamente a las PCD (con una brecha de ocupación de casi 40 puntos), el algoritmo de reclutamiento interpreta que los perfiles atípicos, las lagunas laborales o los diferentes niveles de alfabetización digital de este grupo son señales de bajo rendimiento. El sistema, al reproducir el dataset de la sociedad, amplifica el sesgo histórico en lugar de mitigarlo. Las aplicaciones de reclutamiento basadas en IA resultan, por lo tanto, discriminatorias al no poder realizar ajustes razonables ni tener en cuenta los obstáculos educativos y laborales habituales de las PCD.

La exclusión por falta de diseño inclusivo se manifiesta en fallos concretos de interacción.

| Tipo de Barrera | Discapacidad Afectada | Fallo concreto de la IA | Causa de la exclusión |

| Cognitiva y Lingüística | Deficiencias Cognitivas | Asistentes virtuales o chatbots usan lenguaje excesivamente técnico, frases largas o palabras con muchas sílabas. | La IA está optimizada para el “usuario promedio”, impidiendo el entendimiento de información esencial para personas con dificultades de comprensión. |

| Interacción y Movimiento | Parálisis Cerebral, Discapacidad Motriz y Habla | El sistema de IA no puede procesar ni reconocer patrones de habla o movimiento que no son estándar. | El modelo de machine learning no fue entrenado con la variabilidad funcional humana, lo que lleva a la exclusión total de la persona del servicio digital. |

| Reclutamiento Laboral | Múltiples Discapacidades | Algoritmos de contratación filtran o descartan automáticamente perfiles atípicos (lagunas laborales, trayectorias diversas). | El algoritmo aprende de datos históricos que ya excluyen a las PCD (brecha laboral), amplificando el sesgo social e institucionalizando la discriminación pasiva. |

El reconocimiento de que la IA puede ser un arma de doble filo ha catalizado acciones significativas a nivel internacional y regional para asegurar que el desarrollo tecnológico se centre en la equidad. Las iniciativas globales de la ONU, alineadas con el Pacto Digital Global, abogan firmemente por una IA inclusiva y asequible. El objetivo es maximizar su potencial como motor de desarrollo y como herramienta para la reducción de la pobreza.

La Conferencia de las Naciones Unidas sobre Comercio y Desarrollo (UNCTAD) ha destacado que el enfoque debe ser proactivo, promoviendo la adaptación de soluciones a las infraestructuras locales y la reducción de las barreras de competencias. La IA inclusiva debe buscar “empoderar a los trabajadores, reciclarlos para nuevas funciones e implicarlos en el diseño de herramientas de IA que conserven una parte significativa de trabajo”, moviéndose así de una IA pasiva a una IA colaborativa.

La región ha intensificado sus diálogos de gobernanza en 2024 y 2025. La declaración por una “IA inclusiva y sostenible para las personas y el planeta” se promueve activamente, centrándose en el interés público, los derechos humanos y el desarrollo equitativo. La Unesco ha reiterado su compromiso de fortalecer la gobernanza de la IA en América Latina y el Caribe, garantizando un enfoque centrado en derechos humanos, equidad y transparencia, a través de la colaboración con gobiernos, academia y sociedad civil.

¿Cómo están abordando el desafío las empresas y la academia?

Desde las empresas también se han presentado iniciativas relevantes. GlobalLogic, una empresa del Grupo Hitachi y líder en ingeniería digital, ha anunciado una alianza estratégica con la Asociación Americana de Personas con Discapacidad (AAPD) para crear un marco de gobernanza de Inteligencia Artificial inclusiva. Esta colaboración busca establecer una guía de referencia global para empresas y organizaciones que oriente el desarrollo de soluciones de Inteligencia Artificial (IA) para que sean más accesibles y equitativas.

La iniciativa nace de la misión central del Grupo Hitachi, a la que pertenece GlobalLogic, que se define como “generar impacto positivo en las personas a través de la ingeniería”. Según Juan Navarro, Vice President & Head en Latinoamérica de GlobalLogic, esta visión implica considerar a “todas las personas, no solo de algunas de las personas“, lo que sienta las bases para esta colaboración. “Hay todo un tema de asegurarse que los datos que después sostienen estos modelos, no perpetúan paradigmas que tienen ciertos sesgos o ciertas exclusiones“.

La alianza se encuentra en sus etapas iniciales, pero una de sus primeras premisas es “dar visibilidad a la situación”. Navarro enfatiza la importancia de no “estar desarrollando el futuro y no estar considerando todas las poblaciones que debieras estar considerando en el desarrollo, en la creación de ese futuro. Porque entonces estás construyendo un futuro excluido“, compartió Navarro con Impacto TIC.

En el contexto latinoamericano, Juan Navarro expresó: “La alianza con AAPD nos permite acompañar a las organizaciones y empresas en Colombia y la región en el diseño de soluciones tecnológicas que realmente estén al servicio de la humanidad”. Se espera que lo desarrollado en Estados Unidos sirva como apalancamiento para “nuestros propios desarrollos locales y regionales”.

Este marco de gobernanza de Inteligencia Artificial Inclusiva se centra en tres ejes fundamentales:

- Privacidad: Diseñar protocolos para asegurar que los datos que alimentan los modelos respeten la privacidad individual.

- Equidad: Evitar que los datos sesgados “perpetúan paradigmas que tienen ciertos sesgos o ciertas exclusiones”. El objetivo es corregir los sesgos producidos por “nuestras propias falencias y procesos y estructuras existentes y pasadas”.

- Accesibilidad: Asegurar que la IA, como “nuevo generador de soluciones“, incluya los conceptos de accesibilidad “relevantes en la definición de las soluciones para incluir la accesibilidad de personas con discapacidad”.

Vea la entrevista sobre el marco de gobernanza de GlobalLogic y AAPD

Por otro lado, desde una mirada global, una referencia clave para Latinoamérica es la Estrategia de IA 2024 de España. Este país ha desarrollado documentos para fortalecer el enfoque diferencial e interseccional, –y adicionalmente está liderando el Observatorio de Derechos Digitales–. Un informe ha identificado que las regulaciones a menudo se centran solo en aspectos técnicos sin cuestionar el diseño conceptual que genera la discriminación. Por ello, se aboga por pasar de medidas reactivas a preventivas, evaluando los sistemas con la participación directa de las comunidades afectadas.

Adicionalmente, la iniciativa de crear el modelo de lenguaje ALIA (Artificial Linguistic Intelligence for Administration) busca aumentar significativamente la presencia del castellano y las lenguas cooficiales en el entrenamiento de modelos. Este es un modelo estratégico para Colombia, dada su diversidad lingüística y cultural, ya que asegura que la IA reconozca y responda a las particularidades idiomáticas locales.

Colombia ha reconocido la necesidad de establecer un marco ético para orientar su Transformación Digital, alineándose con los estándares internacionales. El país está trabajando en la creación de un marco regulatorio sólido y efectivo para la IA, cuyo proyecto de ley busca alinearse con los principios de transparencia, equidad y no discriminación de la Unesco. El Programa de las Naciones Unidas para el Desarrollo (PNUD) apoya esta transición, con una visión clara de ayudar a construir una “nación digital abierta e inclusiva“. La estrategia del PNUD promueve activamente la equidad de género y la inclusión en el desarrollo de la IA, a través de programas de alfabetización amplia y atracción de talento especializado.

El Ministerio de Tecnologías de la Información y las Comunicaciones (MinTIC) de Colombia ha mantenido programas de larga data que demuestran la capacidad operativa para la inclusión de la PCD.

En 2024, el programa ConVerTIC superó su meta al registrar 63.495 descargas del software lector (Jaws) y magnificador (Zoomtext) de pantalla. El valor de estas herramientas se ha incrementado con la integración de funciones de IA. Un usuario, un abogado, afirmó que la IA integrada en Jaws le permite “llenar esos vacíos que tenía el software. Jaws es mi herramienta y mi asistente personal“.

De igual manera, el Centro de Relevo facilitó la comunicación entre personas sordas y oyentes, interconectando 416.464 comunicaciones en 2024, alcanzando el 75.7 % de su meta. En este frente también han entrado a participar diferentes empresas del sector, una de ellas es Claro Colombia, que anunció la expansión de su servicio de interpretación en Lengua de Señas Colombiana (LSC), a través de la herramienta Servir, disponible ahora en 30 Centros de Atención y Ventas (CAV) ubicados en Bogotá, Medellín, Cali, Bucaramanga, Santa Marta, Valledupar, Pereira, Neiva, Villavicencio, Cartagena y Barranquilla. Esta iniciativa busca derribar barreras comunicativas y garantizar que las personas sordas puedan acceder a servicios tecnológicos de manera equitativa.

Si bien Colombia tiene programas de acceso sólidos (ConVerTIC, Centro de Relevo), la nueva fase de gobernanza de IA debe asegurar que los algoritmos centrales de decisión (los que manejan procesos de alto riesgo como empleo, beneficios o justicia) sean tan inclusivos como las herramientas de accesibilidad. El desafío radica en la transición del enfoque en las TIC de apoyo a la regulación obligatoria de la IA de alto riesgo para evitar la discriminación por diseño.

El enfoque del Diseño Universal aplica la IA para aumentar las capacidades funcionales, ofreciendo métodos de interacción alternativos que aumentan la autonomía de las personas con discapacidad.

Los desarrollos que adoptan una perspectiva de IA Inclusiva demuestran su potencial transformador:

- OrCam MyEye (Visión por computadora): Este dispositivo portátil, que se monta en las gafas, utiliza IA avanzada. Puede leer texto en voz alta, reconocer rostros y objetos, y proporcionar descripciones auditivas del entorno. Este sistema de visión por computadora ejemplifica cómo la IA, cuando se diseña para aumentar la capacidad, puede mejorar significativamente la autonomía de las personas con discapacidad visual.

- Asistentes Virtuales y comando de voz: Herramientas ampliamente utilizadas como Siri, Alexa y Google Assistant son cruciales para la inclusión. Para personas con discapacidad motriz o visual, estas interfaces permiten realizar acciones cotidianas, desde el control domótico hasta el acceso a información, mediante simples comandos de voz, eliminando la necesidad de manipulación física compleja.

- IA en la Educación: Los sistemas de IA facilitan la inclusión educativa al personalizar el aprendizaje para estudiantes con diversas necesidades funcionales, adaptando formatos, ritmos de estudio y contenidos, garantizando así una educación más equitativa y accesible.

| Tecnología de IA Inclusiva | Función Principal | Discapacidad Beneficiada | Impacto en la Autonomía |

| Dispositivo OrCam MyEye | Visión por computadora y PLN: Lectura de texto, reconocimiento de objetos. | Visual | Autonomía en la navegación, consumo de información y reconocimiento social. |

| Asistentes Virtuales (Siri, Alexa) | Interfaz de voz y comandos de acción/domótica. | Visual, motriz | Eliminación de barreras físicas para el acceso a la tecnología y el control del hogar. |

| IA en ConVerTIC (Jaws/Zoomtext) | Software lector y magnificador con nuevas funciones IA. | Visual | Asistencia avanzada para la productividad profesional y académica. |

¿Cuál es el valor competitivo de adoptar una IA Inclusiva?

La Inteligencia Artificial (IA) Inclusiva, fundamentada en la filosofía de la Inclusión por Diseño (Inclusion by Design o IxD), representa una evolución crítica en la estrategia corporativa que va más allá de la mera responsabilidad social. Este enfoque se posiciona como un motor de crecimiento fundamental, apalancado por una doble ventaja competitiva que genera valor de manera intrínseca y sostenible.

En primer lugar, la IxD permite la captura de un vasto mercado global que permanece en gran medida inexplorado: la Economía de la Discapacidad, cuyo valor total asciende a 18.3 trillones de dólares globalmente, de acuerdo con el reporte ‘The Global Economics of Disability Report‘. Actualmente, 1, 6 mil millones de personas en el mundo tienen una discapacidad. Esta demografía constituye una base de consumo masiva que exige consideración estratégica. Al diseñar soluciones que satisfacen las necesidades funcionales más variadas, las empresas acceden a una base de consumidores con un poder adquisitivo significativo.

El poder adquisitivo inmediato de esta población es significativo y está concentrado en economías desarrolladas. Solo el ingreso disponible total de la Población con Discapacidad (PCD) en Norteamérica y Europa supera los 2,6 trillones de dólares. En Estados Unidos, este ingreso disponible asciende a 1,3 trillones de dólares. Este capital representa una oportunidad inmediata y subexplotada para las empresas que logren diseñar productos y servicios verdaderamente accesibles.

A pesar de este inmenso poder económico, la población con discapacidad enfrenta barreras sistémicas significativas en su interacción con el mercado laboral y los productos digitales. Por ejemplo, en el mercado laboral, los datos revelan una brecha operativa preocupante: existe una diferencia negativa de 41.0 puntos porcentuales en la tasa de ocupación entre la población con y sin discapacidad (19.6 % para PCD versus 60.6 % para personas sin discapacidad en un ejemplo de mercado laboral). Una IA diseñada inclusivamente no solo sirve al consumidor, sino que también tiene la capacidad de mitigar estas brechas operativas al facilitar mayor inclusión en el trabajo y aumentar la productividad global.

En segundo lugar, la IA Inclusiva impulsa la mitigación de riesgos y la excelencia operacional. Esto se manifiesta en un Retorno de Inversión (ROI) tangible a través de la mejora en la calidad y retención del talento , y en la reducción del riesgo legal y reputacional ante marcos regulatorios globales en rápida evolución, como el Reglamento de Inteligencia Artificial de la Unión Europea (EU AI Act).

No menos relevante, hay que tener en cuenta la IA como herramienta para la diversidad. La IA, cuando se implementa con una perspectiva inclusiva, ofrece una ventaja competitiva crítica al promover activamente la diversidad y la inclusión. Esto es vital para combatir la escasez de expertos en IA que, de lo contrario, podría limitar los beneficios potenciales de la tecnología.

En el contexto actual, la tecnología ofrece una oportunidad histórica para cerrar la brecha laboral que mantiene a casi el 40 % de las personas con discapacidad fuera de la ocupación formal. Sin embargo, para lograrlo, la regulación estatal debe asumir un papel central y pasar de un enfoque reactivo contra la discriminación a un diseño preventivo y mandatorio.

Recomendaciones estratégicas y regulatorias

- Regulación mandatoria del diseño inclusivo en Sistemas de Alto Riesgo: Se debe exigir legalmente que los sistemas de IA clasificados como de “alto riesgo” (especialmente en procesos de salud, empleo y justicia) incorporen auditorías de sesgos interseccionales (discapacidad, género, etnia) en sus datasets de entrenamiento. Esto implica cuestionar el diseño conceptual y prohibir los sistemas que, por defecto, generan discriminación, siguiendo el ejemplo de los referentes internacionales.

- Garantizar la participación de comunidades afectadas: La regulación debe obligar a la evaluación de sistemas con la participación directa de las comunidades de PCD, sus organizaciones y expertos en diversidad funcional durante todo el ciclo de vida del dato.

- Inversión en modelos lingüísticos nacionales inclusivos: Colombia debe impulsar el desarrollo de modelos de lenguaje fundamentados en el castellano y las lenguas cooficiales y dialectos locales, de manera similar al modelo estratégico español “ALIA”. Esto aseguraría que la IA reconozca y responda a la diversidad cultural, eliminando el sesgo de la “norma global”.

- Enfoque en recapacitación y diseño: Los programas de IA inclusiva deben enfocarse urgentemente en la recapacitación (reskilling) y la formación especializada de la PCD, implicándolos activamente como codiseñadores de las soluciones futuras, asegurando así que la IA se convierta en una herramienta de empoderamiento y no de exclusión.

El desafío ahora radica en la transición del enfoque en las TIC de apoyo a la regulación obligatoria de la IA de alto riesgo para evitar la discriminación por diseño.