Seamos francos, aunque la computación cuántica ya está entre nosotros, su futuro apenas se está construyendo y lo más interesante es que este no excluye la computación tradicional. Al menos por ahora. Una muestra es la reciente publicación de IBM a mediados de marzo.

Se trata de un modelo dirigido al campo de la supercomputación o computación de alto rendimiento (HPC, por sus siglas en inglés). La propuesta de IBM muestra cómo los procesadores cuánticos (QPU o quantum processors) pueden trabajar junto con las conocidas GPU y CPU —en sistemas locales, centros de investigación y la nube— para abordar grandes retos científicos.

Y aunque en papel esa integración puede sonar sencilla, la realidad es otra. Para comenzar ambas plataformas varían radicalmente desde sus mismas bases. Por ejemplo, en la computación tradicional se usan bits que valen siempre 0 ó 1 mientras en la computación cuántica se usan qubits (o cúbits), que pueden estar en 0, 1 o una superposición de ambos estados a la vez.

Esto implica integrar ambos modelos y ‘traducir’ parte del problema a un formato cuántico y dejar el resto en clásico, lo que complica el diseño del software. En otras palabras, crear varias capas de software interconectadas que permiten a los algoritmos saltar de un entorno a otro sin pérdida de datos.

Jay Gambetta, director de IBM Research e IBM Fellow, afirmó al respecto: “El futuro reside en la supercomputación centrada en la cuántica, donde los procesadores cuánticos trabajan junto con la computación clásica de alto rendimiento para resolver problemas que antes estaban fuera de nuestro alcance”.

Índice de temas

¿Cómo evoluciona el modelo híbrido?

La supercomputación centrada en la cuántica (QCSC o Quantum-Centric Supercomputer) se define hoy como un ecosistema en constante transformación, cuya progresión técnica los expertos estructuran en tres etapas fundamentales. En una fase inicial, los sistemas cuánticos operan como herramientas especializadas o aceleradores dedicados a resolver tareas críticas de alta exigencia dentro de entornos de computación de alto rendimiento (HPC).

A medida que la tecnología avanza hacia una segunda etapa, la relación entre los sistemas clásicos y cuánticos se estrecha mediante el uso de software avanzado; este vínculo permite reducir la latencia significativamente y optimizar la comunicación, facilitando así la ejecución de algoritmos híbridos de mayor complejidad.

Finalmente, este proceso culmina en una tercera fase de integración total, donde ambas arquitecturas se conciben y diseñan de forma conjunta desde su origen. El resultado es una plataforma única y cohesiva, desarrollada específicamente para gestionar flujos de trabajo híbridos de manera nativa y eficiente.

Retos en el camino

A pesar de su inmenso potencial de mercado, proyectado en 2.040 millones de dólares para 2026 y 18.330 millones de dólares para 2034, la computación cuántica se enfrenta a varios desafíos. Para comenzar está la corrección de errores y la decoherencia.

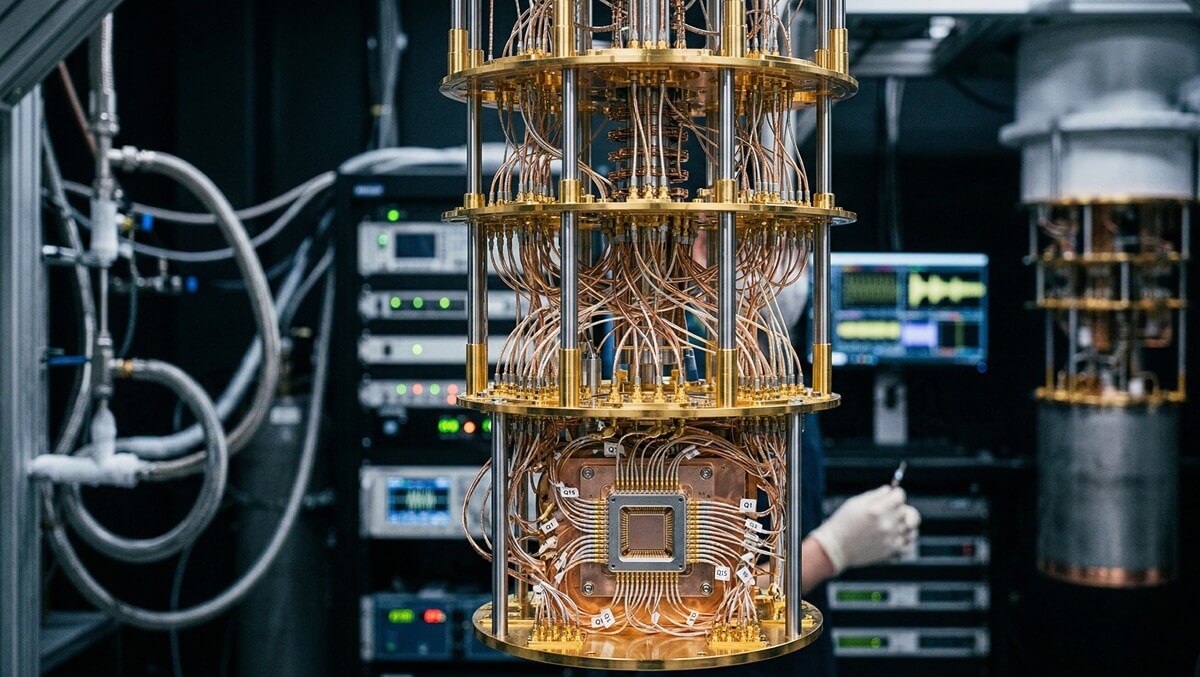

Los qubits son extremadamente frágiles y cualquier interferencia externa, por mínima que sea, destruye la información. El reto es construir sistemas capaces de generar qubits lógicos estables, lo que requiere una infraestructura de refrigeración criogénica masiva, costosa y compleja para mantener los sistemas cerca del cero absoluto.

Por si fuera poco, existe una escasez de talento especializado, ya que la programación cuántica exige un dominio profundo de la física y lenguajes de computación totalmente distintos a los tradicionales.

Impacto en el mundo real

Como parte de la publicación de la nueva arquitectura de cómputo, IBM dio a conocer casos de éxito que implementan este modelo de computación híbrida en instituciones como Oxford y ETH Zurich han logrado hitos, como la creación y verificación de la estructura electrónica de moléculas complejas y la simulación de mini proteínas de 303 átomos.

Otro ejemplo es la colaboración a gran escala entre infraestructuras, ejemplificada en la conexión entre el procesador IBM Quantum Heron y el supercomputador Fugaku. Esta alianza permitió realizar una de las mayores simulaciones de cúmulos de hierro y azufre a través de un intercambio de datos entre nodos clásicos y cuánticos.

Pero estos son apenas la punta del iceberg de la Supercomputación centrada en la cuántica, una disciplina que se espera que cambie profundamente los mercados farmacéutico, financiero, químico, logístico y de ciberseguridad, entre otros; y eso que no hemos hablado de la IA cuántica (QAI).